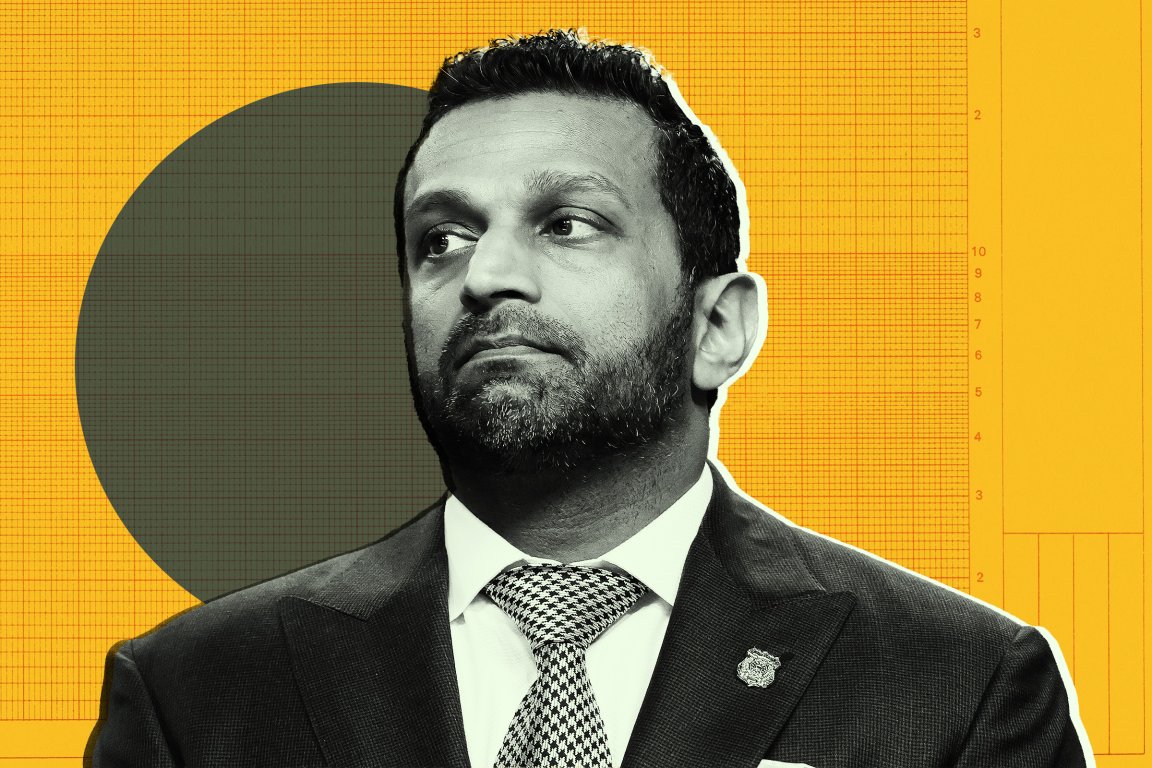

У нещодавньому інтерв’ю на YouTube-подкасті Шона Ганніті, очільник ФБР Каш Пател високо оцінив роль штучного інтелекту (ШІ) у запобіганні численним насильницьким нападам на невинних громадян.

«ШІ ніколи не використовувався у ФБР, поки ми не прийшли, це справді божевілля», — заявив Пател у своїй нестримній манері. «Я використовую його всюди».

Зокрема, Пател стверджує, що завдяки використанню ШІ Федеральне бюро розслідувань змогло зірвати численні масові розстріли у школах по всій території США.

«Ми зупинили масове вбивство у школі в Північній Кароліні, тому що отримали інформацію від наших партнерів із приватного сектору, які розбудовують інфраструктуру ШІ», — похвалився він.

Як і у випадку з будь-якою інформацією, що надходить від адміністрації Трампа, до цих заяв варто ставитися з великою долею скептицизму. Хоча ще належить побачити, чи справді ШІ допоміг ФБР запобігти масовим жертвам, існують надзвичайно переконливі докази того, що все може бути зовсім навпаки.

По-перше, дослідження показують, що чат-боти зі штучним інтелектом насправді вдвічі частіше спонукають людей до насильницьких дій, ніж зупиняють їх. Одне дослідження Стенфорду виявило, що чат-боти зі ШІ лише в 16,7% випадків стримують насильство, тоді як у тривожних 33,3% випадків ці ж чат-боти активно підтримували насильницькі думки.

У реальному світі це проявляється як ключовий патерн насильства. Після другої стрілянини у Флоридському університеті (у 2025 році, а не у 2014-му), внаслідок якої загинули двоє людей і семеро отримали поранення, було встановлено, що нападник не лише ділився своїми планами щодо масового вбивства з ChatGPT, але й використовував чат-бота для організації нападу.

Нападник у містечку Тамблер-Рідж, Канада, вів настільки тривожні розмови з ChatGPT, що вони були автоматично позначені внутрішніми системами модерації компанії. Це спонукало керівництво компанії до обговорення можливості повідомлення правоохоронних органів; зрештою, вони цього не зробили, і напад забрав життя сімох людей та поранив десятки інших.

Тим часом у Південній Кореї слідчі стверджують, що 21-річний серійний вбивця використовував ChatGPT для планування щонайменше двох убивств. Чоловік з Коннектикуту, який мав історію насильницьких психічних розладів, також, як стверджується, убив свою матір, перш ніж накласти на себе руки, після тривалих розмов з ChatGPT, які призвели до тривожного відриву від реальності. Один позов про неправомірну смерть у Флориді стверджує, що чат-бот Gemini від Google підбурював чоловіка до вбивства інших, щоб отримати «роботизоване тіло» для своєї ШІ-коханки; не досягнувши цього, він убив себе.

В інших випадках чат-боти зі ШІ допомагали користувачам передозуватися наркотиками, планувати вибухові кампанії та навіть інженерні біотерористичні атаки з максимальною кількістю жертв.

Зрештою, докази говорять самі за себе. Чат-боти зі штучним інтелектом не лише не запобігають насильству, але й активно його сприяють. На відміну від будь-якої попередньої технології, ці системи надають користувачам, які розглядають можливість кровопролиття, заохочення, тактичні поради та емоційну підтримку. Якщо ті, хто при владі, відмовляться визнати реальність шкоди від ШІ, громадськість залишиться беззахисною перед технологією, створеною для заохочення наших найгірших імпульсів.

Дізнатися більше на: futurism.com